OpenClaw接入Nvidia免费大模型,从此实现大模型token自由

OpenClaw强大的功能一夜爆火,但token消耗量巨大,今天教大家免费接入Nvida免费大模型,从此实现token自由

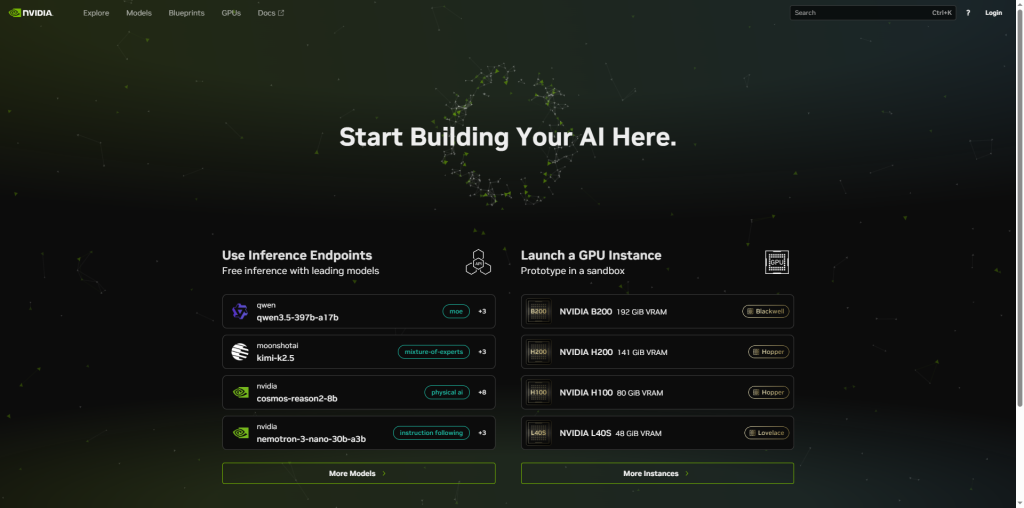

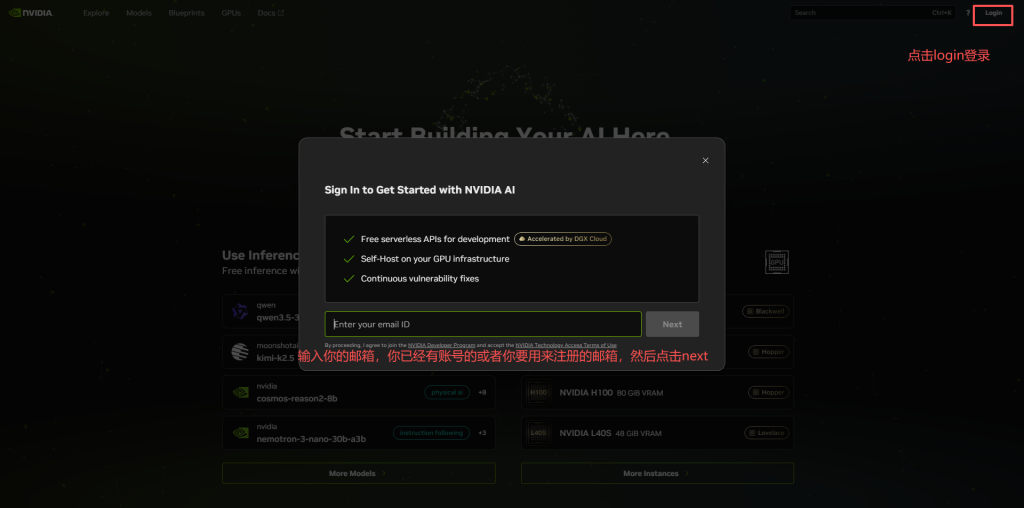

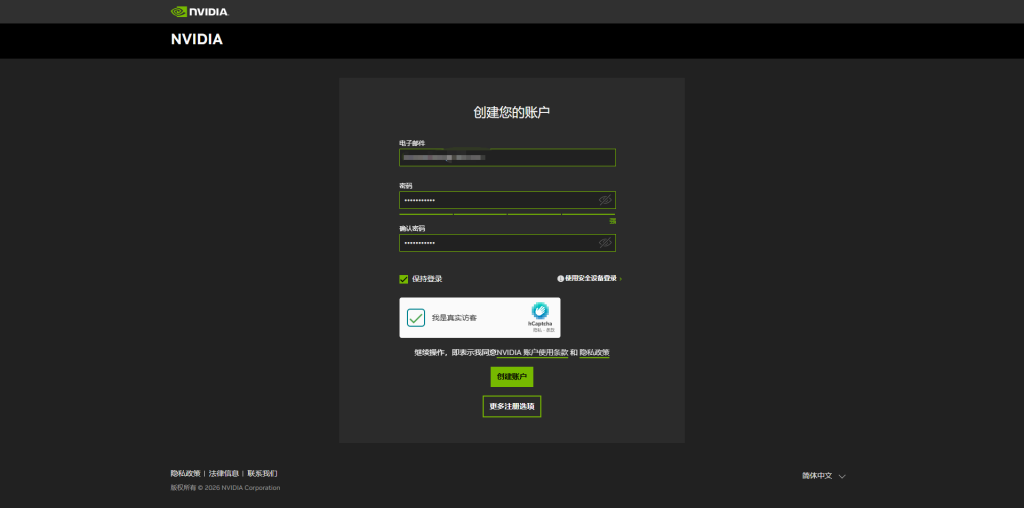

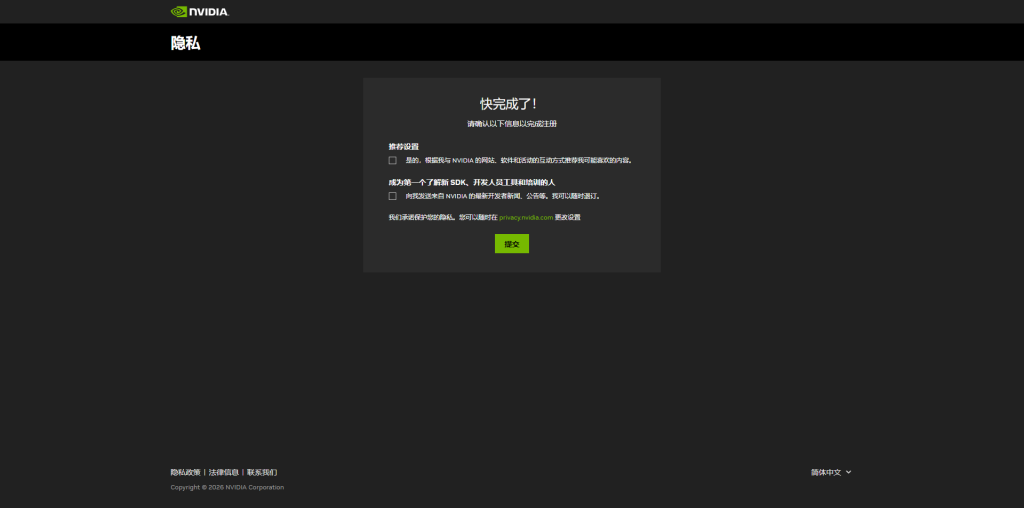

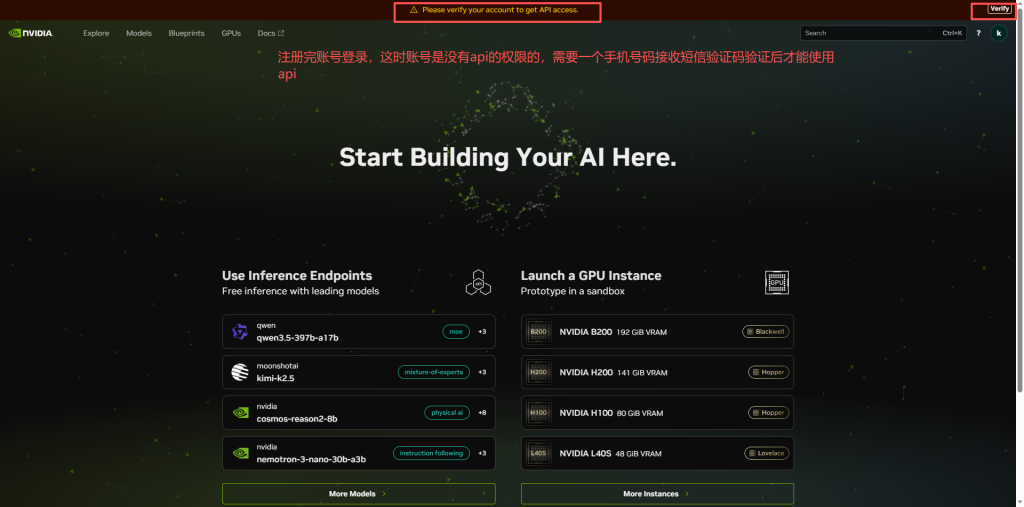

登录Nvidia build官网注册个免费账号

登录地址:https://build.nvidia.com/

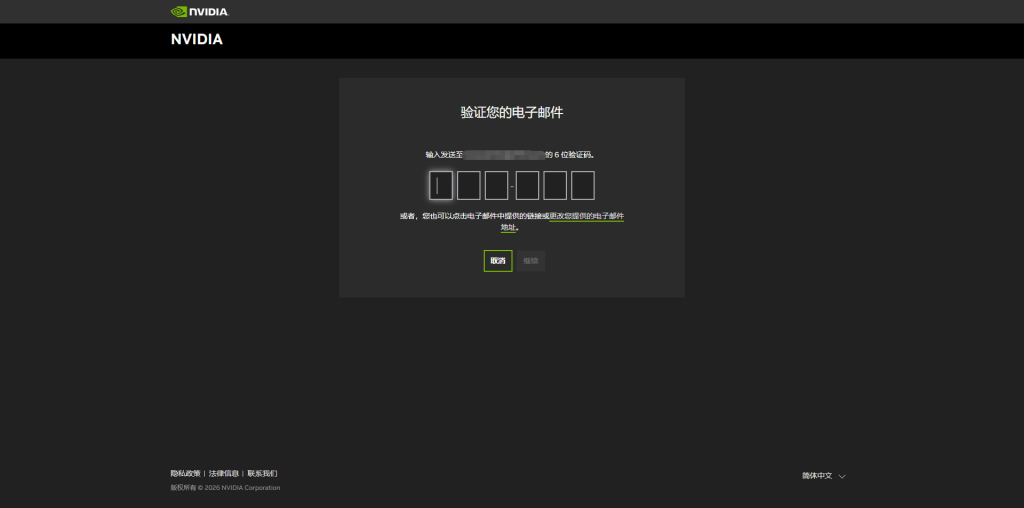

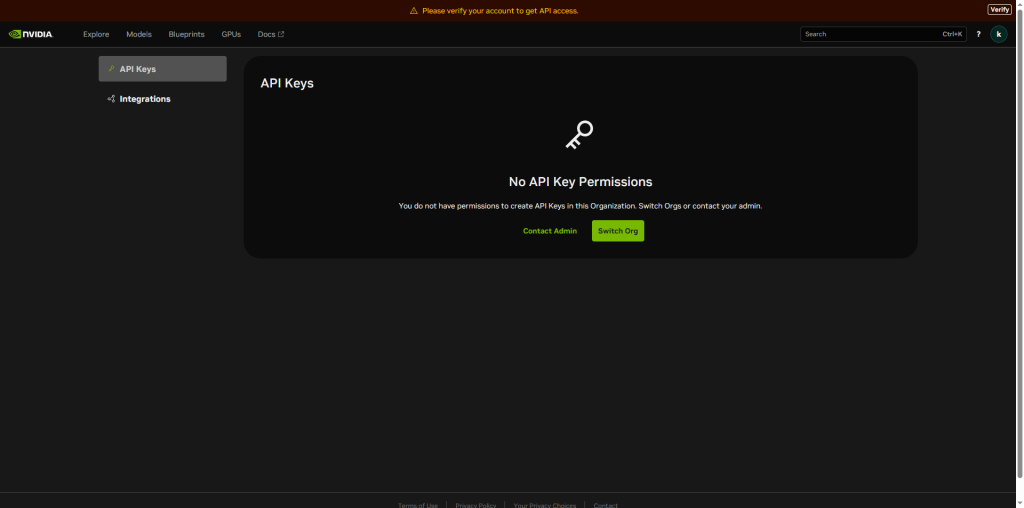

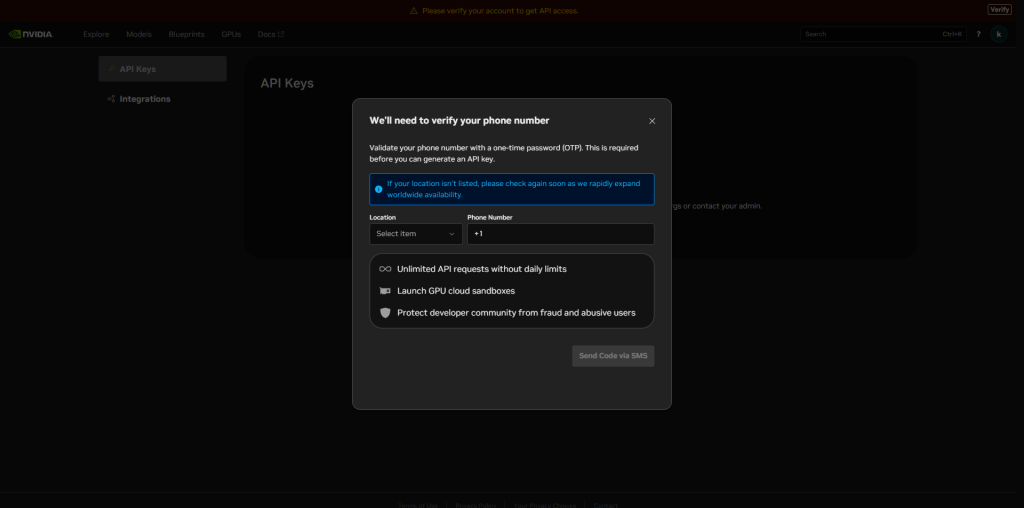

账号验证,账号默认是没有api权限的,需要一个手机接收短信验证码

我试了一下国内的号码貌似是受限制的,接受不了,你们可以先用自己的号码试试,地区可以不用填,只需要填写手机号码就可以,注意要加上区号,中国的区号是+86,如果使用不了可以一些短信接收平台接收短信,只需要验证一次就可以,也可以是使用我推荐的短信接收平台,我就是用这个平台上的号码验证成功的。

短信接收平台推荐:HeroSMS,全世界热门国家的号码可用,最低需充值3$,一个号码费用0.05-1不等,号码如果没成功接收到信息不收费,可以更换其他号码,费用会退到账号上。

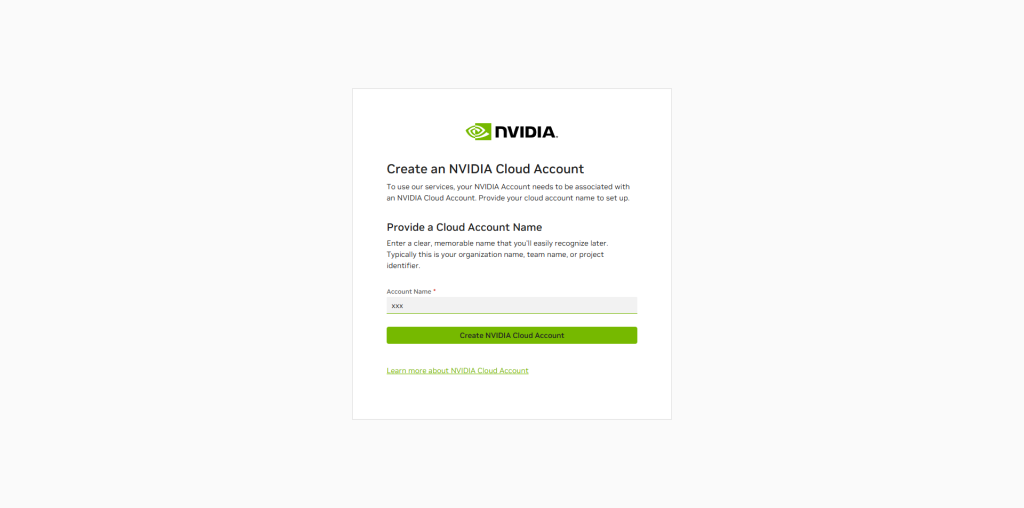

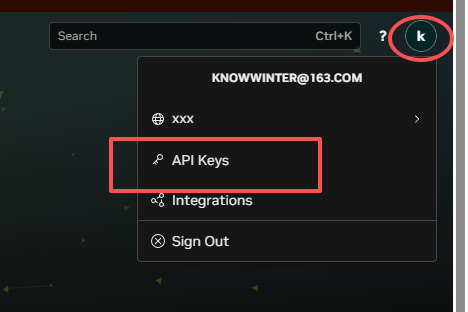

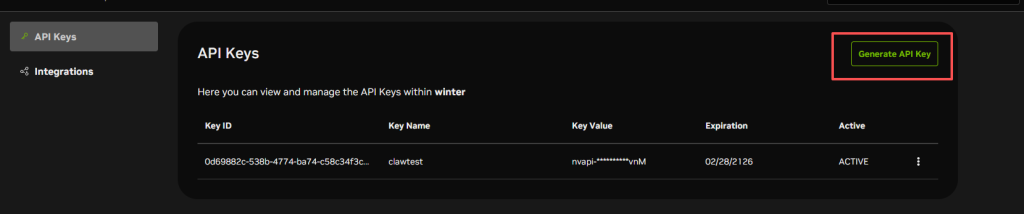

生成api key

配置到openclaw

接下来我们就可以将nvidia免费的大模型配置到我们的openclaw里了,部署安装还不会的同学可以看我另一篇文章 OpenClaw部署安装教程 编辑openclaw.json文件,mac/linux系统通常在~/.openclaw目录下,windows系统通常在C:\Users\Administrator.openclaw下 添加如下内容,如果有models这一段的则在models->providers层级下添加,如没有的则在一层下添加下面整段内容

"models": {

"providers": {

"英伟达nvidia": {

"baseUrl": "https://integrate.api.nvidia.com/v1",

"apiKey": "换成你的nvidia的api key",

"api": "openai-completions",

"models": [

{

"id": "moonshotai/kimi-k2.5",

"name": "Kimi K2.5",

"reasoning": false,

"input": [

"text",

"image"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 262144,

"maxTokens": 32768

},

{

"id": "minimaxai/minimax-m2.1",

"name": "Minimax M2.1",

"reasoning": true,

"input": [

"text",

"image"

],

"contextWindow": 131072,

"maxTokens": 16384

},

{

"id": "qwen/qwen3.5-397b-a17b",

"name": "Qwen3.5-397b-a17b",

"reasoning": true,

"input": [

"text",

"image"

],

"contextWindow": 400000,

"maxTokens": 65536

},

{

"id": "z-ai/glm-5",

"name": "GLM-5",

"reasoning": true,

"input": [

"text"

],

"contextWindow": 202752,

"maxTokens": 16384

}

]

}

}

},在agent下添加model内容如下,model和models为添加内容:

"agents": {

"defaults": {

"model": {

"primary": "英伟达nvidia/moonshotai/kimi-k2.5"

},

"models": {

"英伟达nvidia/moonshotai/kimi-k2.5": {}

},

"workspace": "C:\\Users\\Administrator\\.openclaw\\workspace",

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},配置完保存文件,重启openclaw即可。